バッチサイズはLoRAトレーニングの重要なハイパーパラメータの一つであり、学習効率、品質、メモリ使用量に直接影響します。適切な設定は効果的なLoRAモデルの作成に不可欠です。

バッチサイズの基本概念

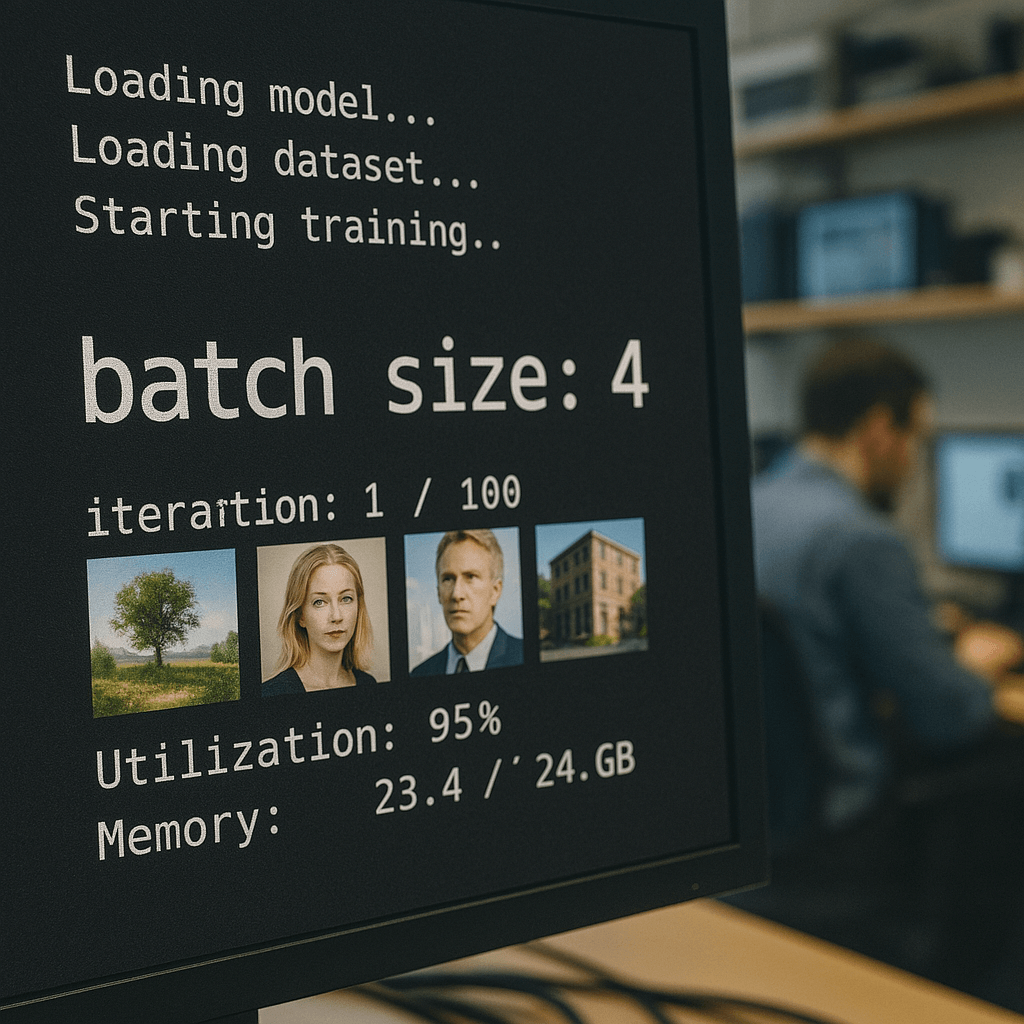

バッチサイズとは、AIが一度に(1ステップで)同時に学習する画像の枚数を指します57。例えば、バッチサイズを2に設定した場合、AIは1回の計算で2枚の画像を同時に処理して学習を進めます。この設定値はトレーニングの進行方法と結果に大きく影響します。

トレーニングプロセスへの影響

バッチサイズの設定は以下の計算式に基づいて総学習回数に影響します:

素材の数 × 繰り返し数 × エポック数 ÷ バッチサイズ = 総ステップ数2

この関係により、バッチサイズを大きくするほど必要なステップ数が減少するため、理論上は学習時間が短縮されます1。

学習効率への影響

計算時間の短縮

バッチサイズを大きくすると、「まとめて計算する」ことで相対的に処理が早くなる効果があります2。特に、総ステップ数が減少するため、全体の学習時間が短縮される傾向があります15。

例えば、あるテストでは同じデータセットを使った場合でも、バッチサイズを大きくすることで学習時間が大幅に短縮されたという報告があります15。

精度と学習量のトレードオフ

しかし、バッチサイズを増やすことには重要なトレードオフがあります。バッチサイズを増やすと精度も上がる可能性がある一方で、相対的な学習量は減少します2。このため、学習効率と精度のバランスを考慮する必要があります。

メモリ使用量への影響

VRAM消費の増加

バッチサイズを増やすと、一度に処理する画像が増えるため、必然的にVRAM(ビデオメモリ)の使用量が増加します2。このため、バッチサイズの上限は使用するGPUのVRAM容量に大きく依存します。

「Out of Memory」エラーの回避

実用的には「out of memoryにならないギリギリを攻める」ことが推奨されています1。使用可能なVRAMの範囲内で最大のバッチサイズを設定することで、計算効率を最大化できます。

Gradient Checkpointingとの関係

バッチサイズを増やすことが難しい場合の代替手段として、gradient checkpointingがありますが、これを有効にすると1ステップあたりの計算時間が2倍近く遅くなるため、バッチサイズを2倍以上に引き上げられる場合にのみ有効化すべきとされています1。

学習結果の品質への影響

個別特徴の学習精度

バッチサイズは学習結果の品質にも影響します。複数の画像を同時に処理するということは、2枚の画像内容の違いが分かりにくくなる可能性があります2。

特にキャラクターの服装が複数あったり、複数のキャラクターを同時に学習させたりする場合など、個別の違いをしっかり覚えさせたい場合はバッチサイズ1の方が良いとされています213。

画風LoRAとキャラクターLoRAの違い

学習内容によってバッチサイズの最適値は異なります:

- キャラクターLoRA:個別特徴の正確な学習が重要なため、バッチサイズを小さくする傾向がある

- 画風LoRA:ディテールをあまりに正確に覚えると「それしか出なくなる」問題があるため、バッチサイズを大きくしても問題ない場合がある2

実験結果からの知見

実際の検証では、バッチサイズを1、2、4と変えて比較した結果、学習結果の質にはほとんど差がなかったという報告もあります15。これは学習内容や他のパラメータとの組み合わせにも依存するため、ケースバイケースと考えられます。

推奨されるバッチサイズの設定値

一般的な推奨値

様々な情報源から、以下のような推奨値が提示されています:

学習内容別の最適化

学習対象によって最適なバッチサイズは変わります:

- キャラクターLoRA:1〜2が推奨

- 画風LoRA:より大きいバッチサイズ(2〜4以上)も許容される

- 複数キャラクターの同時学習:1が推奨13

用途による選択

現実的には、自分のハードウェア環境(GPUのVRAM容量)と目的に応じて調整するのが最も効果的です:

- VRAM容量が限られている場合:1〜2

- 学習時間を短縮したい場合:可能な限り大きく

- 精度を重視する場合:内容に応じて1〜2

結論:バッチサイズ設定のベストプラクティス

LoRAトレーニングにおけるバッチサイズ設定は、以下の点を考慮して決定すべきです:

- ハードウェア制限: out of memoryエラーが発生しない最大値を探る1

- 学習内容: キャラクターなど個別特徴の正確な学習が必要な場合は小さく、画風など全体的な特徴を学習する場合は大きく設定

- 学習時間: 短縮したい場合はできるだけ大きく、ただし学習量の減少と精度のバランスを考慮

- 他パラメータとの調整: バッチサイズを大きくした場合に減った学習量を補うために、ステップ数や学習率を調整することも検討2

最終的には、これらのファクターのバランスを取りながら、自分の環境と目的に最適なバッチサイズを見つけることが重要です。また、複数の設定でテスト学習を行い、結果を比較検討することも効果的な方法です。